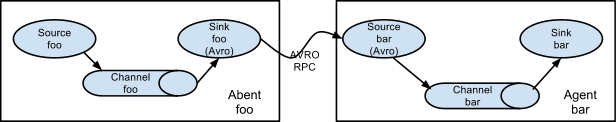

In order to flow the data across multiple agents or hops, the sink of the previous agent and source of the current hop need to be avro type with the sink pointing to the hostname (or IP address) and port of the source.

Hop 1:

a1.channels.ch1.type = memory a1.sources.avro-source1.channels = ch1 a1.sources.avro-source1.type = avro a1.sources.avro-source1.bind = 0.0.0.0 a1.sources.avro-source1.port = 41414 a1.sinks.avro-sink1.channel = ch1 a1.sinks.avro-sink1.type = avro a1.sinks.avro-sink1.hostname = 192.168.10.204 a1.sinks.avro-sink1.port = 5545 a1.sinks.avro-sink1.batch-size = 1 a1.channels = ch1 a1.sources = avro-source1 a1.sinks = avro-sink1

Hop2

a1.channels.ch1.type = memory a1.sources.avro-source1.channels = ch1 a1.sources.avro-source1.type = avro a1.sources.avro-source1.bind = 0.0.0.0 a1.sources.avro-source1.port = 5545 a1.sinks.log-sink1.channel = ch1 a1.sinks.log-sink1.type = logger a1.channels = ch1 a1.sources = avro-source1 a1.sinks = log-sink1

test using avro-client

flume-ng avro-client -H dmining05 --port 41414 -F /etc/passwd

References

http://flume.apache.org/FlumeUserGuide.html

相关推荐

flume:构建高可用、可扩展的海量日志采集系统 flume:构建高可用、可扩展的海量日志采集系统

其中上篇介绍了HDFS以及流式数据/日志的问题,同时还谈到了Flume是如何解决这些问题的。本书展示了Flume的架构,包括将数据移动到数据库中以及从数据库中获取数据、NoSQL数据存储和性能调优。对于各个架构组件(源、...

一个简单的工程,已经设置各种配置,直接只用maven打包好就可以在flume工程包新建plugins.d/custom/lib 目录,并拷贝到下面,并将工程里面的conf文件拷贝到flume的conf目录下启动命令 nohup flume-ng agent -n ...

flume sink serializer用到的序列化类 org.apache.flume.serialization.AvroEventSerializer$Builder

Flume是Cloudera提供的一个高可用的,高可靠的,分布式的海量日志采集、聚合和传输的系统,Flume支持在日志系统中定制各类数据发送方,用于收集数据;同时,Flume提供对数据进行简单处理,并写到各种数据接受方(可...

由于flume官方并未提供ftp,source的支持; 因此想使用ftp文件服务器的资源作为数据的来源就需要自定义ftpsource,根据github:https://github.com/keedio/flume-ftp-source,提示下载相关jar,再此作为记录。

通过修改flume源码实现flume向两个HA hadoop集群分发数据。

Flume:构建高可用、可扩展的海量日志采集系统 第一部分

flume 自定义sink组件 实现sink直接写入mysql数据库

Apache Flume, Distributed Log Collection for Hadoop,2015 第二版,Packt Publishing

及Source端增加的一些选择器、拦截器:多路复用/路由器Selector、timestamp拦截器、Serach And Replace Interceptor、Regex Filter Interceptor、Regex Extractor Interceptor、Host Interceptor、Static ...

通过修改flume源码实现flume向两个HA hadoop集群分发数据。

flume-ng安装

flume1.8.0 采集日志入库到hive,后台日志报错,是心跳bug,此包为修复jar包

FlumeKafkaSink 这个项目是汇插件生产,以 。...# Describe/configure the source a1.sources.r1.type = netcat a1.sources.r1.bind = 192.168.2.102 a1.sources.r1.port = 44444 a1.channels.c1.type =

rocketmq-flume Source&Sink该项目用于与之间的消息接收和投递。首先请确定您已经对和有了基本的了解确保本地maven库中已经存在,或者下载RocketMQ源码自行编译在rocketmq-flume项目根目录执行mvn clean install ...

Title: Using Flume: Flexible, Scalable, and Reliable Data Streaming Author: Hari Shreedharan Length: 238 pages Edition: 1 Language: English Publisher: O'Reilly Media Publication Date: 2014-10-02 ISBN-...

flume断点续传覆盖jar,使用组件flume-taildir-source-1.9.0覆盖flume/bin目录下的jar即可

Flumeng简介 Apache Flume是从不同数据源收集、聚合、传输大量数据、日志到数据中心的分布式系统,具有可靠、可伸缩、可定制、高可用、高性能等明显优点。其主要特点有:声明式配置,可动态更新;提供上下文路由,...